Ieri seară s-a derulat keynote-ul conferinței WWDC 2024 unde Apple a prezentat primele detalii despre Apple Intelligence, adică AI-ul pe care îl va integra în iOS 18, macOS Sequoia și iPadOS 18 sub forma unui LLM local și conectivitate cu ChatGPT. În esență este o abordare interesantă pe care Apple o propune sub sloganul păstrării intimității și doar dacă utilizatorul va dori să folosească serviciile terțe ChatGPT sau chiar Gemini.

Apple Intelligence: o abordare cu LLM local

Trebuie să recunosc că spre deosebire de toate chestiile prezentate de Microsoft în care Copilot face și drege, Apple a venit cu o perspectivă mai interesantă și de departe mai utilă: AI-ul (și aici mă refer la Apple Intelligence, că așa au decis să numească platforma) se va integra într-o grămadă de aplicații și va oferi o experiență care să ajute utilizatorul punctual. Exemplele sunt multiple, de la un nou Siri și până la opțiuni coerente de lucru cu Notes sau aplicația Calculator, proaspăt lansată pe iPadOS.

Cu toate că am văzut chestii similare propuse de Microsoft via Copilot în Windows, faptul că Apple are avantajul integrării unui AI în telefon și tabletă, pe lângă PC, dă o perspectivă mai utilă și poate că va reuși să convingă și mai multă lume că e o direcție bună (pe mine nu mă poate convinge pentru că nu văd sub nicio formă utilitatea, alta decât promovarea imposturii și a minciunii).

Ideea e așa: toată lumea integrează AI-ul. Pe smartphone a venit Samsung și a propus câteva scenarii: îmbunătățirea pozelor, traducere în timp real, descoperirea de informații prin Google etc., reformularea de text, sumarizare automată, scenarii care sunt punctuale și decuplate de sistemul de operare. Pentru moment Google nu a făcut niciun pas major în direcția asta pe Android, iar Microsoft pe Windows a dat cu mucii în baltă cu Recall.

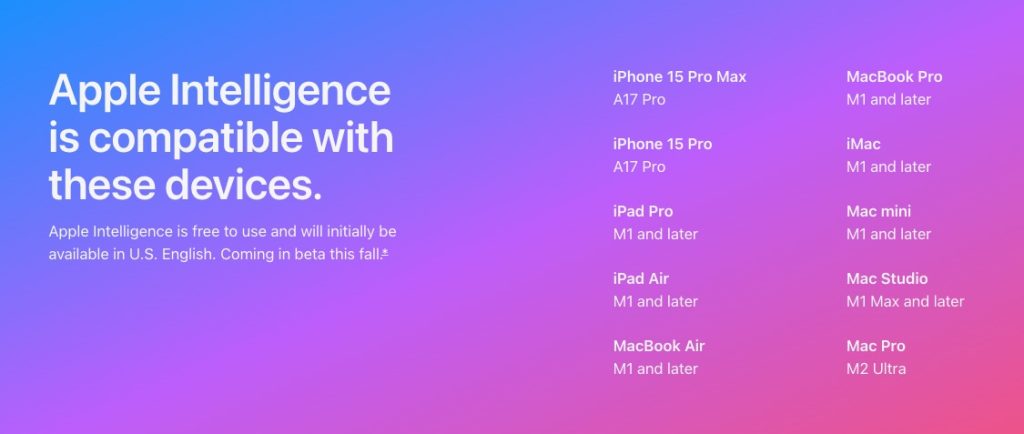

Apple pornește în epopeea AI susținând sus și tare că cel mai important este controlul a ceea ce face Ai-ul și faptul că datele personale nu pleacă de pe dispozitiv. Pentru asta folosește un set LLM propriu, capabil să funcționeze pe modelele cu Apple Silicon M pentru tablete și MacBook-uri, însă doar pe generația iPhone 15 Pro vizavi de smartphone-uri (probabil din cauza necesarului mare de memorie RAM), iar atunci când e nevoie de mai mult să poată apela la procesarea în cloud (aici sunt lucruri pe care Apple a încercat să le explice, nu suficient pentru că datele personale tot pleacă de pe aparat, chiar dacă se duce într-un cloud securizat, construit pe infrastructura și cu hardware-ul Apple).

AI pentru scris

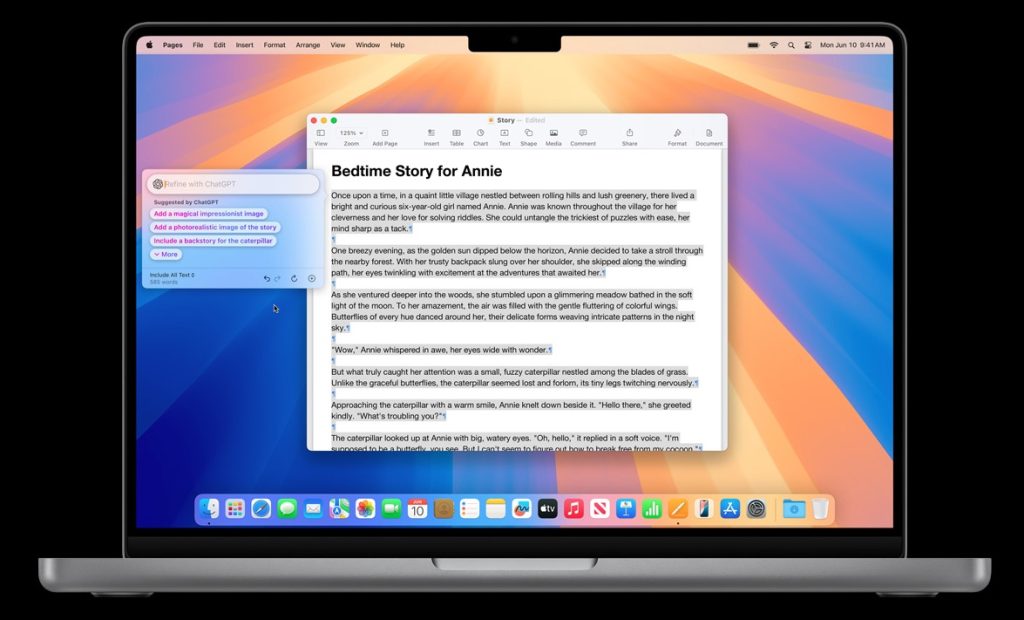

După cum era de așteptat, primul scenariu în care Apple Intelligence va veni să ˝ajute˝ utilizatorul este la scris. Fie că vorbim de mail-uri sau proiecte în Notes, AI-ul va putea fi apelat și folosit să ˝transforme˝ ideile în chestii mai profesionale sau … mai coerente. Adică așa cum am spus deja, să pară că cel ce scrie e mai deștept, mai cultivat, mai experimentat dacă va folosi Rewrite și Proofrea sau opțiunea de generare a unui rezumat. E evident că tot incultul și nepregătitul o să sară și o să aplaude ideea pentru că îl va face să pară altul decât e el în realitate, doar că va trebui să folosească doar limba engleză la început.

Din punctul meu de vedere o utilitate mai mare o are noua opțiune de selectare a proprității notificărilor din iOS 18, unde AI-ul va putea să ˝citească˝ și să ˝înțeleagă˝ mesajele (email, Message), prezentând un sumar al acestora în locul informației pure – să zicem că primiți pe email un mesaj de la un prieten, AI-ul va putea să vă spună sumarul în locul mesajului. Asta dacă veți avea încredere că ce zice AI-ul e și corect.

Mai mult, treaba asta ar putea să funcționeze și dacă puneți AI-ul să analizeze un mesaj audio, pentru care va genera transcrierea și apoi sumarul.

Și ca următor pas, Apple Intelligence va învăța suficient despre utilizator încât să știe să îl protejeze de notificări ce îl pot distrage, prin filtrarea automată a ce e important și ce nu – ca de exemplu că va lăsa să treacă un apel de la familie, dar nu și unul necunoscut.

AI pentru imagini

În zona de imagini, propunerea Apple seamănă cu ce am văzut la Samsung și Microsoft: repararea de fotografii (Image Wand), organizarea inteligentă în Photos și generarea inteligentă de slide-show-uri via Memory Movie și nu în ultimul rând generarea unor imagini noi plecând de la text (sau de la contextul din jurul momentului în care se încearcă generarea). La bază stă Image Playground și rezultatul va fi nu doar soluții gata de a fi integrate în documente ci și un nou set de emoji-uri personalizate, denumite de Apple Genmoji.

Un Siri mai deștept

Și nu neapărat în ultimul rând, asistentul digital inutil denumit Siri s-ar putea să înceapă să fie de folos datorită Apple Intelligence și integrării cu ChatGPT și poate Gemini. Siri are acum un nou aspect, atenționează utilizatorul când e în modul ˝ascultare˝ și poate fi controlat și cu comenzi scrise.

Poate că acum, prin integrarea cu AI-ul, Siri să devină util – va putea înțelege ce i se cere și o să dea răspunsuri mai utile – o treabă interesantă este aceea în care va fi capabil să îți explice unde găsești anumite funcții din iOS/macOS/iPadOS, cum le folosești și la ce te ajută (treabă pe care Microsoft a integrat-o deja de ceva vreme în Windows).

De reținut este că Siri va putea să își dea seama despre context prin interpretarea informațiilor de pe ecranul aparatului și să se comporte ca atare.

Pentru început, Siri va conlucra cu ChatGPT 4o și utilizatorului i se va prezenta opțiunea de a apela la acest serviciu atunci când e nevoie – după cum zice Apple, ChatGPT va intra în acțiune doar dacă utilizatorul e de acord cu asta, prezentându-i clar opțiunile disponibile. Și pentru moment nu e nevoie de un cont plătit pentru a putea folosi ChatGPT – sunt sigur că în foarte scurt timp asta se va schimba și doar cei ce vor plăti al … Nșpelea abonament Apple vor putea folosi integrarea.

Apple Intelligence la nivel de … O SĂ!

La fel ca în cazul Google când a vorbit de AI, toate chestiile pe care vi le-am povestit sunt la nivel de … O SĂ, pentru că nu am văzut demo-uri live cu așa ceva. De altfel Apple spune și că Apple Intelligence va fi disponibil … cândva și doar pe anumite modele de aparate și doar pentru utilizatorii cu US English și în niciun caz pentru toți.

De aici înțelege fiecare ce vrea – mai exact că Apple Intelligence e încă în stadiul de dezvoltare.

Poate că vestea cea mai rea pentru unii este că nu toate aparatele iPhone capabile să instaleze viitorul iOS 18 vor putea și să folosească Apple Intelligence. Conform Apple, doar modelele iPhone 15 Pro au această capabilitate – cumva e normal, Apple vrea să aibă un instrument de a stimula vânzările viitoarei serii iPhone 16.

În principiu toată platforma Apple Intelligence va putea să fie accesată de aplicații terțe, pentru care vor exista API-uri, accesate în mod responsabil.

Apple a tot încercat să transmită ideea asta: Apple Intelligence va fi un AI consumat responsabil. Cu datele care rămân local, cu LLM local etc. și foarte puțin off-load pe cloud – au avut chiar disponibilitatea să spun că modul de funcționare va putea fi analizat de către cercetători independenți. Cred că e prima dată când aud o astfel de afirmație din partea Apple.

Doar că la final problema este aceiași: ca să poată funcționa eficient, AI-ul va trebui să învețe o grămadă de chestii despre utilizator. Poate că Apple nu a făcut greșeala Microsoft cu Recall în care să spună direct că utilizatorul e monitorizat pentru a fi ˝profilat˝ eficient. Însă în esență vorbim fix de același lucru: Apple Intelligence va fi preinstalat, activ și va monitoriza și învăța ce face utilzatorul, va putea accesa datele de context (poze de pe ecran, conținutul email-urilor, parole, aplicații folosite etc.) fără ca utilizatorul să poată dezactiva treba asta – cel puțin la momentul actual.

Bombardamentul ăsta cu AI-ul e deja la cote maxime și odată ce ajunge să fie parte integrantă și a smartphone-ului, va fi grav de tot. Că e de la Microsoft, Google sau Apple, nici măcar nu contează: odată ce îl vom lăsa să învețe chestii despre noi, o să fim și mai tare victimele manipulărilor fără a mai putea ieși ușor din capcana: ˝ce chestie, uite ce treabă bună mi-a propus. Exact ceea ce speram˝, limitându-ne opțiunile.

Înainte să aplaudați direcția Apple, voi ce ziceți?

Eu aș zice că suntem bine. Asta făcea și Siri înainte, scana totul pentru a îți oferi pe „tavă” diverse informații, doar că acum îți scanează Apple Intelligence. Ce nu îmi place este faptul că au introdus ChatGPT. De ce? Au avut la dispoziție ani de zile de date pe care le puteau folosi pentru a își crea propriul serviciu de inteligență artificială.

Sincer nu îmi place nici un model de AI fie el chatgpt, gemini, galaxy ai sau ce alte mizerii de sucative ar mai fi.

Suntem de acord cu prima parte – diferenta este ca Siri e degeaba si ca Apple Intelligence va fi agresiv.